Dans un article récent, le climatologue J. Hansen présente une étude quantitative des événements climatiques extrêmes et de leur évolution au cours du XXe siècle. Pour cela, il étudie la distribution de températures moyennes sur des régions de taille limitée du globe (des carrés de 250 km de côté), pendant quelques mois, et trace la courbe représentant la distribution de ces événements, décennie par décennie. Pour une période de référence donnée, la courbe obtenue est proche de la distribution dite "normale de Gauss", qui donne une courbe en cloche autour d'une valeur moyenne. Une distribution gaussienne de probabilité est complétement déterminée par 2 valeurs

* la valeur centrale (la valeur la plus probable) x0

* la dispersion ou "écart type" autour de cette valeur, c'est à dire, l'écart moyen que les valeurs prennent autour de cette moyenne, notée usuellement σ

La connaissance de ces deux valeurs permet de calculer la probabilité d'avoir la variable x entre deux valeurs proches, x et x +dx (où dx est un petit intervalle, par exemple entre 2 et 2,1 ) :

C'est la représentation de cette fonction dite "densité de probabilité" qui est donnée par la célèbre "courbe de Gauss", pour une distribution dite "normale" (A noter que contrairement à ce qu'on croit souvent, rien n'oblige une distribution de probabilités à être "normale". Le théorème central limite assure simplement que c'est le cas limite quand on regarde la moyenne d'un grand nombre de distributions quelconques indépendantes, ce qui est le cas quand une grandeur dépend d'une multitude d'influences différentes indépendantes - mais ce n'est pas forcément le cas).

Si on mesure l'ecart de la variable x, soit x-x0, "en nombre de fois l'écart type σ ", ce qui revient à poser u = (x-x0)/s , alors c'est une courbe universelle, le pourcentage de valeurs s'écartant d'un certain nombre de fois σ étant toujours le même. Ainsi

* 68 % des fois environ, la valeur x est écartée de x0 à moins de 1 σ

* 95 % des fois environ , la valeur x est écartée de x0 à moins de 2 σ

* 99,7 % des fois environ , la valeur x est écartée de x0 à moins de 3 σ

il y a donc moins de 0,3 % de chance de s'écarter de la valeur centrale de plus de 3σ, et que la moitié (0,15 %) de chaque coté : un évènement écarté de plus de 3σ est donc considéré comme "exceptionnel".

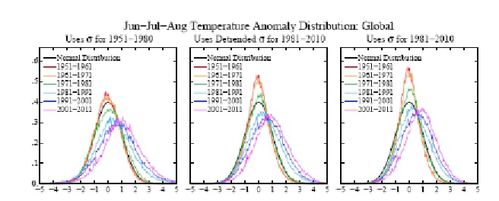

Pour en revenir aux températures, donc, Hansen et al. choisissent une période de référence dont ils calculent la moyenne et l'écart type σ (les résultats vont dépendre de la période choisie) pour chaque zone. Puis, pour les autres périodes, ils tracent l'écart par rapport à la moyenne de la période de référence, divisé par l'écart type de la période de référence. Autrement dit, ils comparent les histogrammes des températures des différentes périodes à celle de référence, en les normalisant sur les paramètres de la période de référence. Il est à noter qu'en normalisant une distribution normale sur ses propres valeurs, on retombe toujours sur la même courbe standard et donc on ne peut voir aucune variation ! il faut la normaliser sur une autre période pour la comparer à elle.

Si il n'y avait pas de variation climatique, les histogrammes devraient évidemment être constants, aux incertitudes statistiques près. En fait, ils notent une variation sensible de l'histogramme, à la fois dans la valeur moyenne, mais, ce qui est plus surprenant, également dans la largeur de la distribution σ . Cela rend les évènements "extrêmes" plus probables, à la fois à cause du déplacement moyen et de la largeur plus grande. Ainsi, ils concluent que les évènements extrêmes comme la canicule de Russie ou la sécheresse du Texas sont "vraisemblablement " attribuables au changement climatique.

Il n'est évidemment pas question de refaire ici l'étude de Hansen et al., qui sont experts dans le traitement des données climatiques. Cependant, un détail curieux m'a frappé en regardant ces courbes. L'élargissement est bien sûr notable, et il peut facilement être perçu en regardant la baisse de la valeur maximale centrale de la distribution. En effet, une propriété mathématique d'une courbe de Gauss est que sa surface est directement proportionnelle au produit de son amplitude par sa largeur σ . (La valeur exacte est racine(2π)*A*σ mais le coefficient constant n'a pas d'importance). Comme les histogrammes sont normalisés à 1 (ce sont des probabilités), il en résulte que l'amplitude maximale est inversement proportionnelle à la largeur (A = 1/(racine(2π)*σ), ce qu'on peut vérifier de visu : plus le pic est large, moins son maximum est élevé.

La chose un peu curieuse, c'est que l'élargissement semble s'etre produit assez tot, dans les années 80-90 (baisse de l'amplitude, mais peu de décalage en température), et qu'il a été ENSUITE suivi d'un décalage en température, à largeur à peu près constante.

Qu'est ce que cela signifie? je n'en sais rien, mais ça ne semble pas avoir été relevé par les auteurs. Ca semble en tout cas montrer que l'élargissement n'est pas directement imputable au même phénomène que le réchauffement. Est ce que c'est due à une autre cause (variation naturelle) ? est ce que ça pourrait être dû à des artefacts de mesures de température dans la période moderne par rapport aux plus anciennes ? aucune idée, mais il serait souhaitable de creuser un peu la question pour savoir si toutes les variations observées sont vraiment imputables aux mêmes causes.... et donc extrapolables dans le futur.

[PARTIE INUTILE , LA FIGURE EN QUESTION A ETE SUPPRIMEE DANS UNE NOUVELLE VERSION ]

Une autre chose également curieuse est que ce phénomène semble dépendre de la période de référence sur laquelle on calcule le σ. Là encore il y a sûrement une subtilité statistique (la discussion dans le papier n'est pas très explicite), et en particulier j'ai du mal à voir la différence entre leur figure 4 (ci-dessus) et leur figure 9, où la variation de l'écart type n'apparait pas quand on prend comme référence les 30 dernières années :

Je n'en ai pas très bien compris la raison (il est évident que changer de période de base change l'écart type, mais pourquoi ça influe sur la DIFFERENCE d'écart type entre différentes périodes ?), si un lecteur plus perspicace pouvait nous éclairer ...

[FIN DE LA PARTIE INUTILE]

Dans l'ensemble, une impression que j'ai souvent eue est que les études statistiques sur le climat s'accompagnent souvent de points peu clairs de statistique, mal exposés ou mal compris, et sont souvent "interprétées" assez sommairement. Les discussions sur les reconstructions par proxies ont montré quand même qu'il y avait facilement des possibilités d'artefacts dans les traitements statistiques, il est utile de garder ça en mémoire ...